Berri官网网页版登录入口

- Berri官网地址:https://www.litellm.ai/

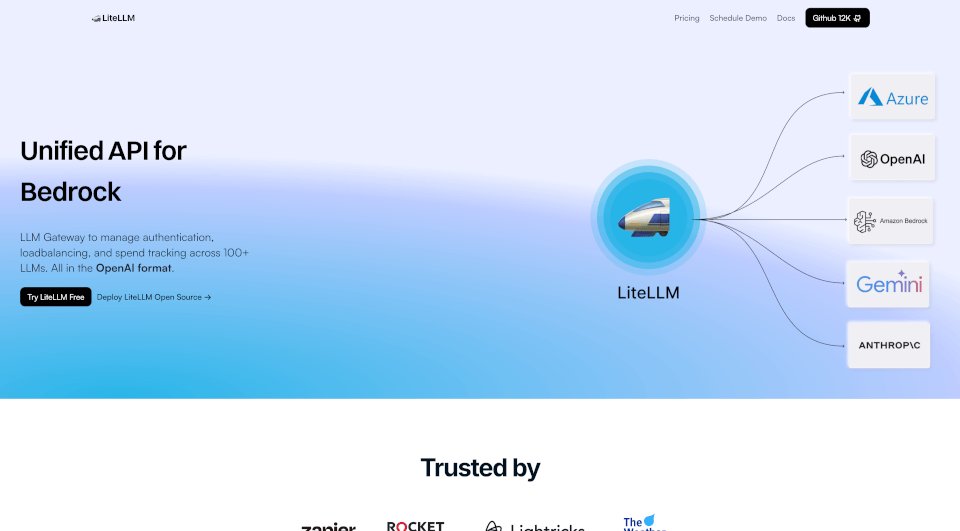

LiteLLM 是一个强大的工具,帮助开发者轻松访问和管理超过 100 种大型语言模型(LLMs)。它提供了负载均衡、备用方案和支出跟踪功能,并且所有操作都基于 OpenAI 的格式。无论是 Azure、Gemini 还是 Bedrock,LiteLLM 都能让你无缝接入这些平台。

Berri的核心功能

模型访问控制:通过虚拟密钥、团队和模型访问组来控制模型的使用权限。

预算与速率限制:跟踪支出并设置预算限制,确保资源合理分配。

日志与支出跟踪:将请求、响应和使用数据记录到 s3、datadog、OTEL 等平台。

OpenAI 兼容 API:以 OpenAI 格式访问 100+ LLMs,支持 /chat/completion、/embedding 等接口。

自服务门户:允许团队登录并管理自己的密钥,提升生产环境的灵活性。

Berri的使用案例

企业级模型管理:适合需要管理多个 LLMs 的企业,确保资源高效利用。

开发者工具:帮助开发者快速迁移项目,并通过代理端点进行支出跟踪和日志记录。

团队协作:通过自服务门户,团队成员可以独立管理密钥,提升工作效率。

如何使用Berri

安装 LiteLLM Python SDK,快速接入各种 LLMs。

使用 LiteLLM Gateway 作为代理,实现模型访问、备用方案和支出跟踪。

通过自服务门户,团队成员可以轻松管理自己的密钥。

Berri常见问题:

Q:: LiteLLM 支持哪些 LLM 提供商?

A: LiteLLM 支持超过 100 种 LLM 提供商,包括 Azure、Gemini、Bedrock 和 OpenAI。

Q:: 如何跟踪支出和设置预算?

A: 通过 LiteLLM 的预算与速率限制功能,你可以轻松跟踪支出并设置预算限制,确保资源合理分配。

Q:: LiteLLM 是否支持日志记录?

A: 是的,LiteLLM 支持将请求、响应和使用数据记录到 s3、datadog、OTEL 等平台。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...

想要以后继续访问本站,按住Ctrl+D键,把aoxox.com收藏起来吧!